El análisis de datos identifica contenidos falsos en la semana previa y la semana posterior a la segunda vuelta. Santa Cruz concentra casi la mitad de los casos, con piezas dirigidas principalmente contra candidatos y, en varios casos, elaboradas con inteligencia artificial.

- Desinformación focalizada en candidatos y categorías de desinformación

- Inteligencia artificial como método de desinformación

- Manipulación de contenido real con información fabricada

- Análisis de discurso

- Las redes sociales y su amplificación en momentos de alta atención

- Conclusión: dos momentos, una misma lógica de desinformación

En el marco de la segunda vuelta de las Elecciones Subnacionales 2026, Bolivia Verifica realizó un monitoreo específico de contenidos desinformativos difundidos en redes sociales durante dos momentos clave del proceso electoral: la semana previa a la votación (del 12 al 19 de abril) y la semana posterior a los resultados (del 20 al 26 de abril).

Este recorte temporal responde a los periodos de mayor sensibilidad informativa: el primero, marcado por la toma de decisiones del electorado, el debate público y la circulación intensiva de mensajes políticos; y el segundo, caracterizado por la reacción a los resultados, la interpretación de la derrota o la victoria y la intensificación de narrativas de confrontación.

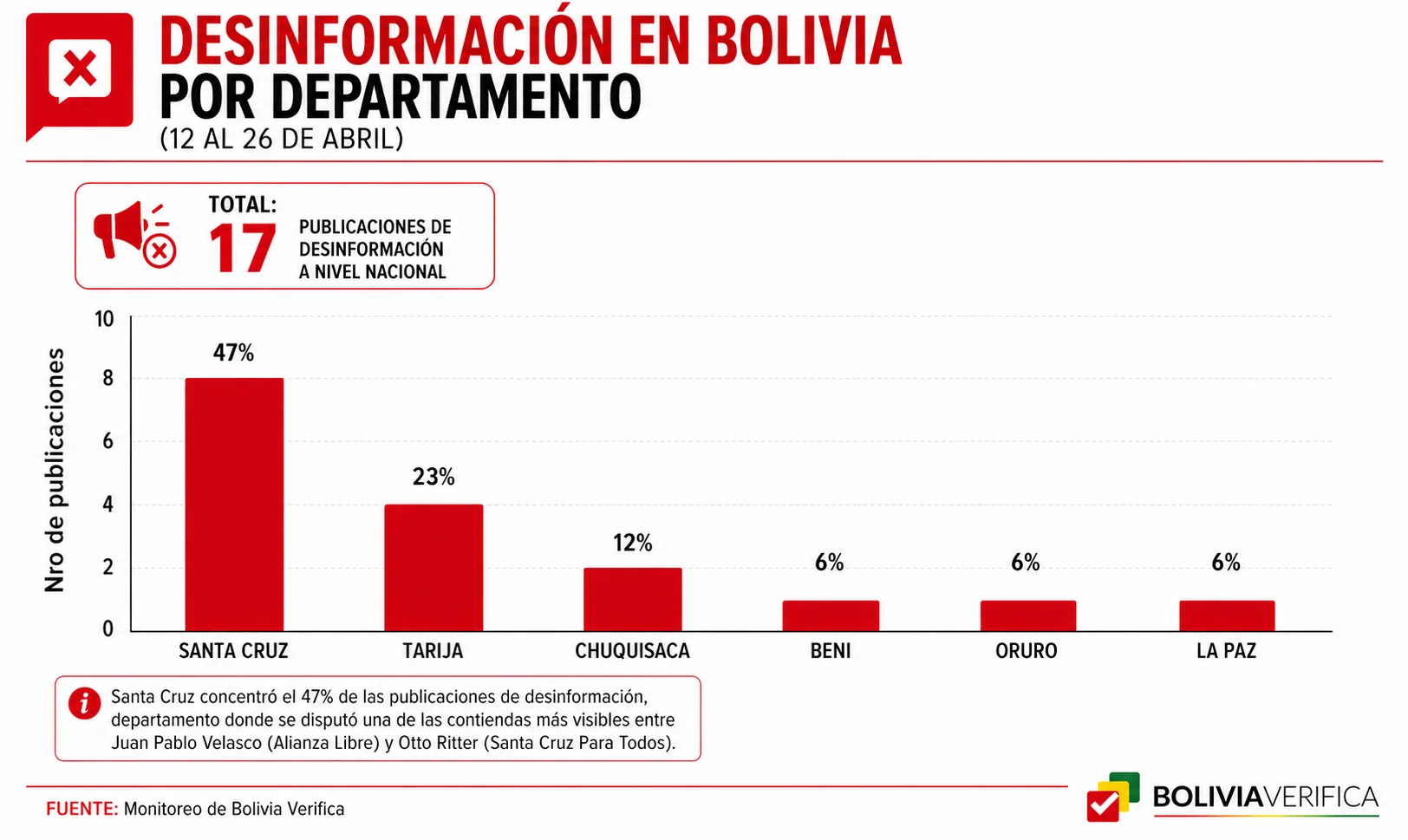

En ese contexto, se detectaron 17 publicaciones de desinformación a nivel nacional. De ese total, el 47% (8 casos) se concentró en Santa Cruz, donde se disputó una de las contiendas más visibles entre Juan Pablo Velasco (Alianza Libre) y Otto Ritter (Santa Cruz Para Todos). El resto de los casos se distribuye de la siguiente manera: el 23% (4) corresponde a Tarija, el 12% (2) a Chuquisaca y el 6% (1) a cada uno de los departamentos de Beni, Oruro y La Paz.

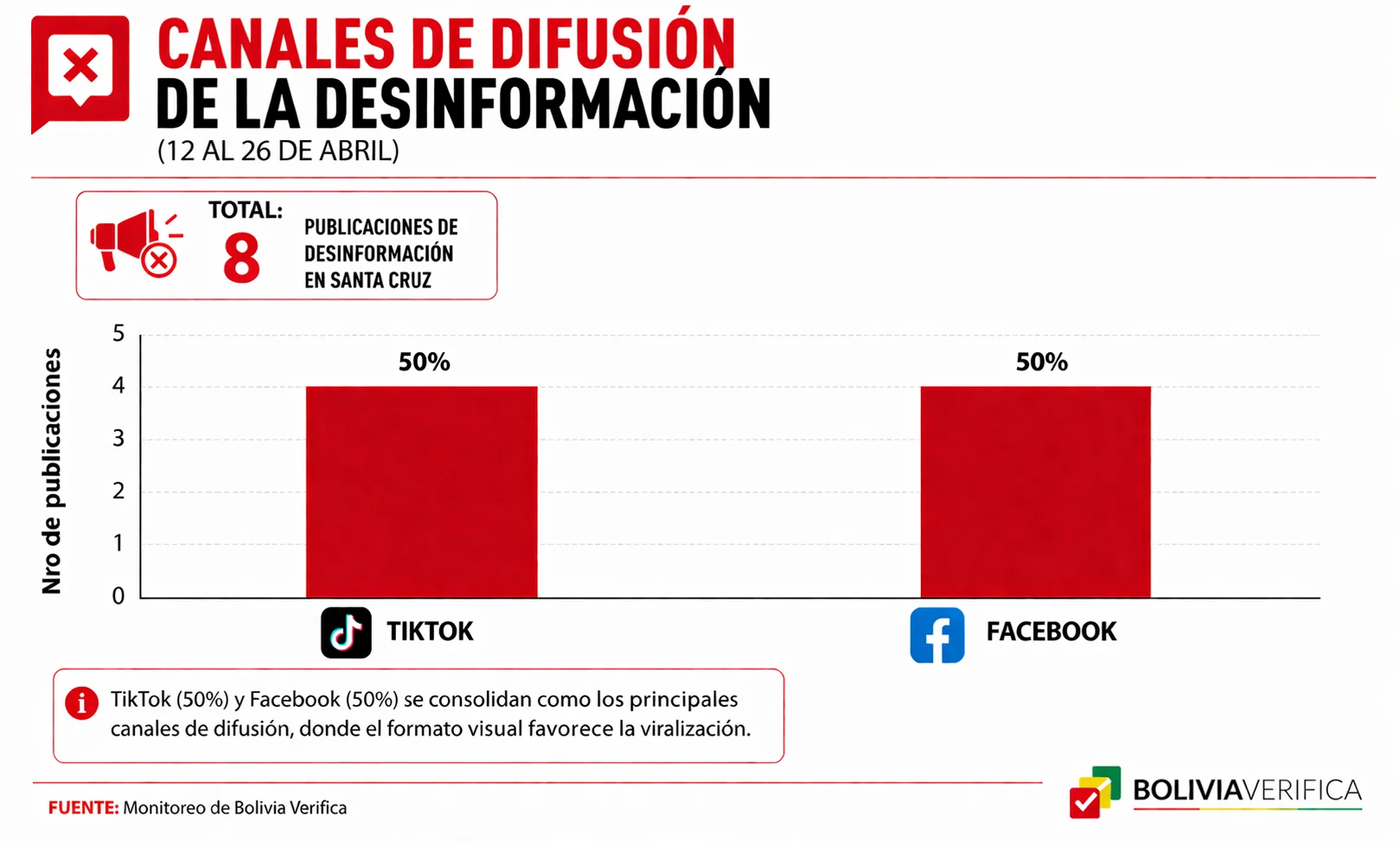

Estos contenidos circularon principalmente en Facebook y Tik Tok, plataformas donde la desinformación se amplificó rápidamente a través de cuentas personales y páginas no verificadas.

Desinformación focalizada en candidatos y categorías de desinformación

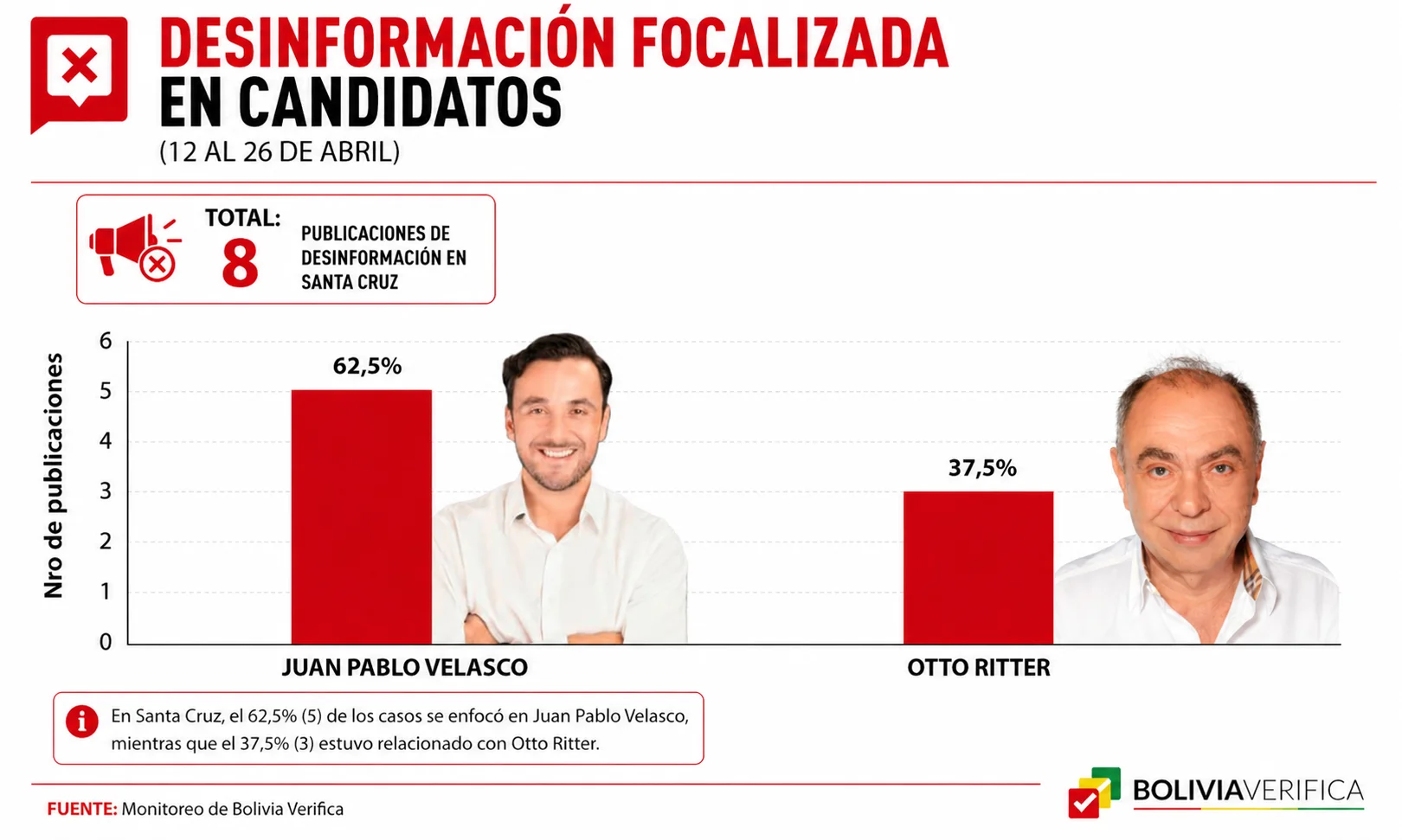

El análisis muestra que, especialmente en la semana previa a la votación, la desinformación se concentró en afectar directamente a los candidatos en competencia.

En Santa Cruz, el 62,5% (5 casos) de los contenidos se enfocó en Juan Pablo Velasco, mientras que el 37,5% (3 casos) estuvo relacionado con Otto Ritter.

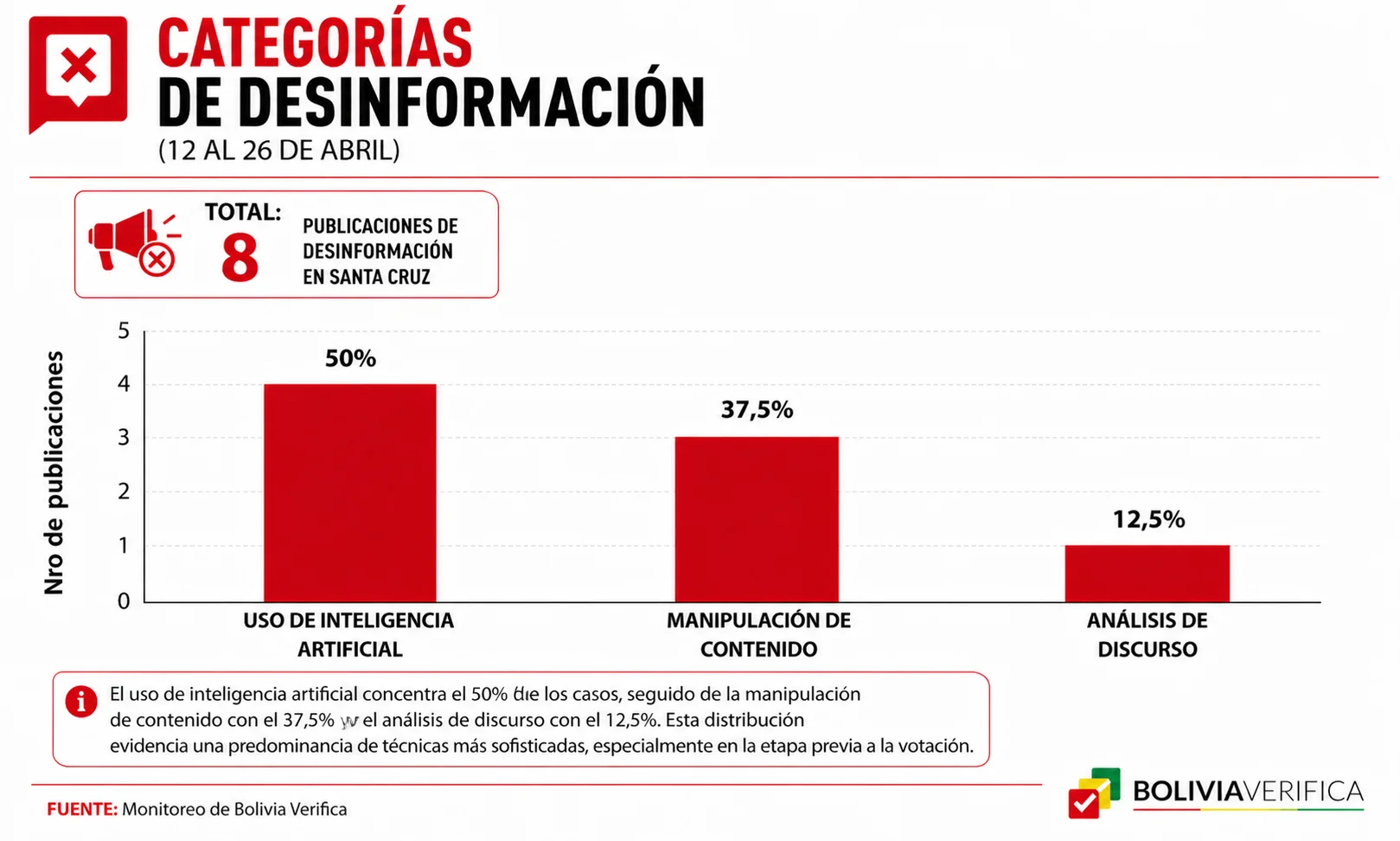

A partir del análisis de los contenidos verificados, se identificaron distintos mecanismos de producción y circulación de desinformación. Esta clasificación permite comprender no solo el contenido de las publicaciones, sino también las estrategias utilizadas para influir en la percepción pública en un contexto electoral.

En total, se identificaron tres categorías principales. El uso de inteligencia artificial concentra el 50% (4 casos), la manipulación de contenido real representa el 37,5% (3 casos) y el análisis de discurso el 12,5% (1 caso). Esta distribución evidencia una predominancia de técnicas más sofisticadas, especialmente en la etapa previa a la votación.

Inteligencia artificial como método de desinformación

Durante la semana previa a la elección se identificó un uso intensivo de inteligencia artificial, que concentra el 50% de los casos. Este hallazgo evidencia una mayor sofisticación en los métodos de desinformación en momentos clave del proceso electoral.

En este periodo circularon audios falsos atribuidos al concejal Juan Carlos Medrano, en los que se lo vinculaba con acuerdos políticos y financiamiento de campaña a favor de Juan Pablo Velasco. Se verificaron al menos dos piezas relevantes: una que atribuía un presunto financiamiento de la familia Crapuzzi y otra que señalaba la existencia de un acuerdo político negado públicamente por el candidato.

Ambos casos corresponden a desinformación generada mediante inteligencia artificial. En el primero, el audio difundido por la cuenta @papito.rico426 en Tik Tok presentó inconsistencias técnicas y fue identificado por herramientas especializadas con más del 90% de probabilidad de haber sido generado con IA.

Deepfake: Audio atribuido a Medrano sobre un financiamiento a Juan Pablo Velasco es falso

En el segundo, un video publicado por la cuenta “lapeta.de.otto” atribuía un “audio filtrado” a Medrano; sin embargo, el análisis técnico y la versión del propio concejal confirmaron que el contenido era falso.

Es falso el audio atribuido a Juan Carlos Medrano que circula en redes tras el debate electoral

Asimismo, se difundió una imagen generada con inteligencia artificial en la que el alcalde electo Manuel “Mamen” Saavedra aparecía junto a Juan Pablo Velasco, simulando una alianza política confirmada. El contenido fue difundido en Facebook por la cuenta “Camiri noticia” y reutilizado con distintos textos para amplificar la idea de respaldo político.

Falso: imagen de Mamen Saavedra y JP Velasco fue generada con IA

En paralelo, circuló un video manipulado en el que Saavedra pedía votar por Velasco. El material, difundido en Tik Tok por la cuenta “@K4r4j0”, alteraba el mensaje original y elementos visuales para simular un pronunciamiento político.

Es falso que Mamen Saavedra haya pedido votar por Libre, el video fue alterado con IA

La difusión de estos contenidos se produjo en un momento estratégico, en el que el respaldo de figuras políticas podía influir en la decisión del electorado.

Manipulación de contenido real con información fabricada

El 37,5% de los casos corresponde a manipulación de contenido real, una estrategia presente tanto antes como después de la elección. Estos contenidos parten de material auténtico, como imágenes o videos de medios, que son alterados o recontextualizados para generar nuevas narrativas.

Uno de los casos más representativos fue la “inhabilitación” de Juan Pablo Velasco atribuida al Tribunal Supremo Electoral. La pieza, difundida en Tik Tok por la cuenta “@sebastin.bardoza”, utilizaba la línea gráfica del medio El Deber para simular una noticia oficial.

Este tipo de contenido, difundido antes de la votación, puede generar dudas sobre la legitimidad de un candidato o desincentivar la participación electoral.

Después del balotaje, circularon contenidos atribuidos a Otto Ritter en los que se responsabilizaba a Angélica Sosa por su derrota. Estas piezas manipulaban imágenes reales de medios como Red Uno y El Deber (aquí y aquí), alterando declaraciones originales para generar confrontación.

Falso: atribuyen declaración a Otto Ritter contra Angélica Sosa por quedar en segundo lugar

El Deber no publicó imagen que atribuye a Otto Ritter una declaración sobre Angélica Sosa

A diferencia de la etapa previa, estos contenidos buscan influir en la interpretación de los resultados, instalando narrativas sobre responsabilidades y conflictos políticos internos.

Análisis de discurso

El análisis también identifica un 12,5% de casos vinculados a afirmaciones incorrectas realizadas en espacios públicos de alta visibilidad.

Durante el debate electoral realizado el 12 de abril, Otto Ritter utilizó una referencia histórica errónea sobre Cristóbal Colón, atribuyéndole un hecho que no cuenta con respaldo en registros verificables.

Este tipo de desinformación no se construye a partir de contenido manipulado, sino de declaraciones que reproducen información inexacta, lo que evidencia que también puede originarse en intervenciones públicas y amplificarse en escenarios de alta exposición mediática.

Las redes sociales y su amplificación en momentos de alta atención

El rol de las redes sociales es clave en ambos periodos. Durante la semana previa, los contenidos circulan con mayor intensidad y urgencia, buscando impactar en la decisión de voto. En la semana posterior, en cambio, se enfocan en sostener narrativas, generar debate y reforzar posiciones políticas.

Tik Tok (50%) y Facebook (50%) se consolidan como los principales canales de difusión, donde el formato visual favorece la viralización.

Conclusión: dos momentos, una misma lógica de desinformación

El análisis evidencia que la desinformación no ocurre de manera aleatoria, sino que responde a momentos específicos del proceso electoral.

En la semana previa predomina el intento de influir en la decisión del electorado mediante contenidos dirigidos a los candidatos. En la semana posterior, en cambio, se busca reinterpretar los resultados y mantener activas determinadas narrativas políticas.

En ambos casos, el uso de inteligencia artificial, la manipulación de contenido real y la simulación de formatos periodísticos muestran una evolución en las estrategias de desinformación, cada vez más sofisticadas y adaptadas al contexto.

Este comportamiento confirma que la desinformación no solo acompaña los procesos electorales, sino que se inserta estratégicamente en sus momentos más críticos.