El análisis fue elaborado por tres equipos de Witness —organización aliada de Bolivia Verifica— usando herramientas de código cerrado. Bolivia Verifica recuerda a sus lectores que las herramientas de código abierto o gratuitas no dan resultados concluyentes ni son 100% confiables.

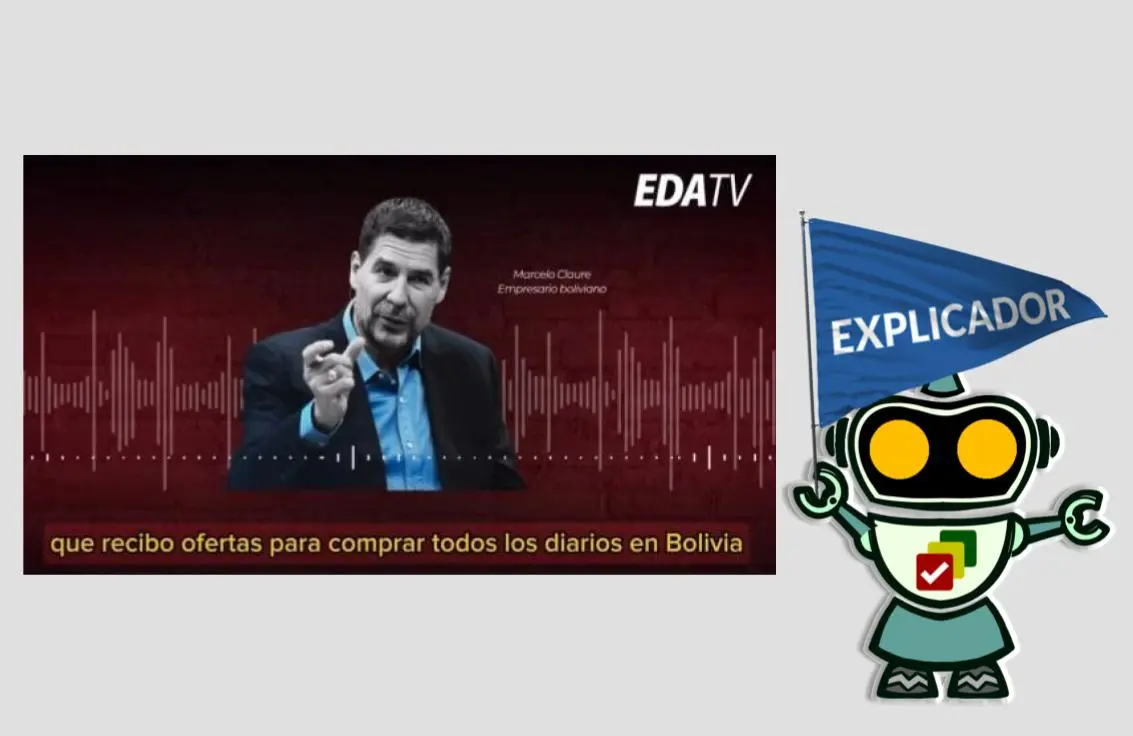

La semana que terminó, el medio español EDATV difundió un audio en inglés asegurando que el empresario Marcelo Claure «admite que comprando los medios puede imponer a un político y controlarlo como una marioneta». Ante la viralización del archivo sonoro, Bolivia Verifica lo analizó en colaboración con tres equipos de peritos internacionales de la organización Witness.

Los expertos concluyeron que es altamente «probable que el audio no haya sido manipulado por IA, pero podría ser una combinación de diferentes grabaciones». En este Explicador, te contamos todos los detalles del análisis.

El audio de 36 segundos fue difundido el 3 de agosto y está en inglés, pero en los subtítulos se lee lo siguiente:

«Y otra cosa que tenemos que pensar, si vamos a comprometernos y ser serios. puedes comprar medios de Bolivia por nada. Quiero decir que sabes que recibo ofertas para comprar todos los diarios en Bolivia por un par de millones de dólares. Sabes que básicamente puedes tener el control, Bolivia sigue siendo un país con periódicos en crecimiento, más redes sociales, etcétera.

Así que es relativamente fácil mover un país que conoces y creo que será un experimento divertido, ya sabes podemos poner el político adecuado para una buena causa. Hay que asegurarse de que ponemos a alguien que realmente dirige el país mejor».

Bolivia Verifica envió el material a sus aliados del Grupo de Respuesta Rápida de Deepfakes de Witness para tener un diagnóstico preciso del contenido. Tres equipos lo revisaron por separado con diferentes herramientas de código cerrado y metodologías de análisis, y el proceso de análisis establece que es altamente probable que «el audio no haya sido manipulado por IA, pero podría haber sido una combinación de diferentes grabaciones».

A continuación, detallamos los resultados de cada uno de los análisis:

Equipo 1

El análisis que hizo este grupo de especialistas consistió en segmentar el audio en 3 partes de 12 segundos cada una para ver alguna incidencia de inteligencia artificial (IA).

«La primera parte fue marcada como probablemente generada, mientras que la segunda y la tercera no lo fueron. Al escuchar el audio, los expertos notaron una transición muy antinatural a los ~7 segundos de la grabación. Basándose en su interpretación del espectrograma de audio y del propio audio, su evaluación sugiere que los primeros 7 segundos causaron el diagnóstico falso. El equipo también notó que el audio pudo ser una combinación de grabaciones diferentes sacadas de sus contextos originales».

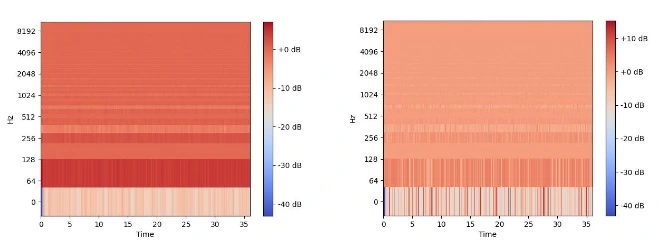

A continuación podrás ver los espectrogramas (la representación visual de un sonido): al lado izquierdo el audio atribuido a Claure y al derecho la imagen de cómo la herramienta esperaba que se viera el audio:

Según su resultado, el audio pudo ser manipulado por IA en sus primeros 7 segundos, pero este resultado no es concluyente. Y advierten que el análisis tuvo una limitación y es que el ruido de fondo sugiere que se usó un micrófono de un dispositivo antiguo sin cancelación de ruido para grabar el audio. «Nuestra teoría es que esto pudo haberse hecho para eliminar cualquier rastro digital del audio».

Equipo 2

El Equipo 2 segmentó más de 120 veces el audio para identificar su veracidad o falsedad, pero tuvo resultados mixtos, por lo que no llegaron a una conclusión clara. Sus limitaciones fueron el ruido, la calidad del audio y el idioma, según su reporte.

Equipo 3

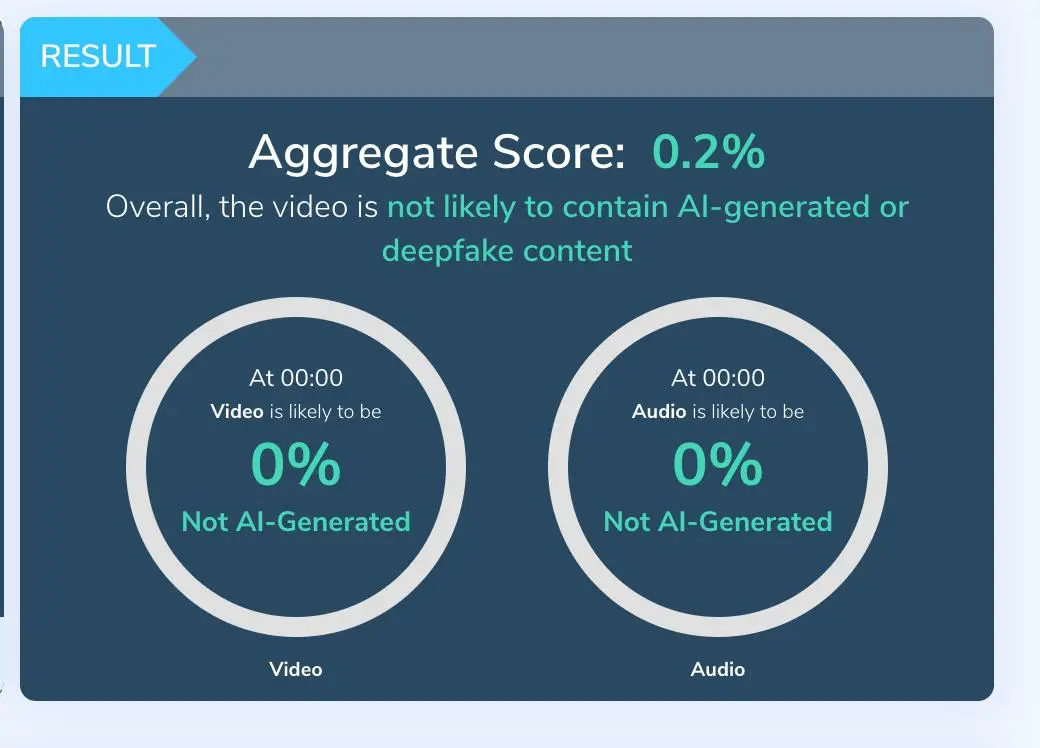

El equipo 3 concluyó que el audio no presenta manipulaciones con inteligencia artificial (IA).

«El equipo encontró algunas instancias de ruidos de fondo y ruido por manipulación del micrófono. Estos ruidos indican que la grabación se realizó en un espacio con características acústicas auténticas.

Los expertos también han identificado una frecuencia resonante que está presente en la voz, alrededor de 500 Hz, debido a la acústica del espacio en el que se realizó la grabación. Además, el sonido de lo que parece ser el crujido de una silla a los 14 segundos también tiene una resonancia similar. Esta es una indicación de que la grabación de la voz y los sonidos de fondo se realizaron en el mismo espacio y que la grabación es muy probablemente auténtica«.

En su reporte menciona que también hicieron una ingeniería inversa de la voz de Claure, «utilizando la generación de voz con aprendizaje automático y usando las muestras conocidas de su voz. Al escuchar críticamente la voz generada sintéticamente por el equipo y compararla con el audio en cuestión, el equipo cree que el audio en cuestión exhibe un perfil de hablante y una patología que la voz generada sintéticamente no logró capturar. El equipo no encontró ningún artefacto de audio típicamente asociado con el audio sintético. Esto sugiere que el audio en cuestión probablemente no fue generado sintéticamente.

La única limitante que notaron es la calidad de la grabación.

Análisis de Bolivia Verifica

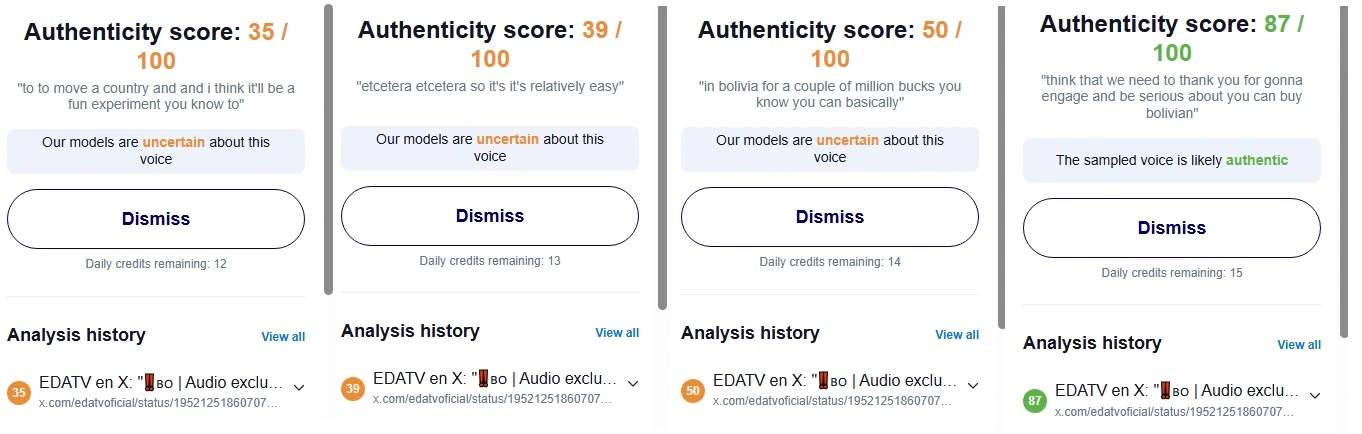

El equipo de Bolivia Verifica sometió el audio al análisis de herramientas gratuitas que de igual modo no fueron concluyentes. Al usarlas en diferentes momentos del audio arrojaron resultados diferentes, pero ninguno concluyó que se tratara de una creación con inteligencia artificial:

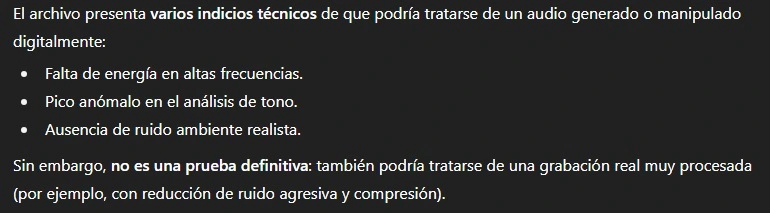

Usando herramientas de verificación de paga se concluyó que hay indicios técnicos que sugieren una manipulación digital, pero aclaran que no es una prueba definitiva.

Asimismo, se comparó el material con otro audio de Claure hablando en inglés y con aplicaciones de edición de audios se comparó ambos contenidos, pero tampoco se identificó algún dato concluyente que certifique que es o no es el empresario.

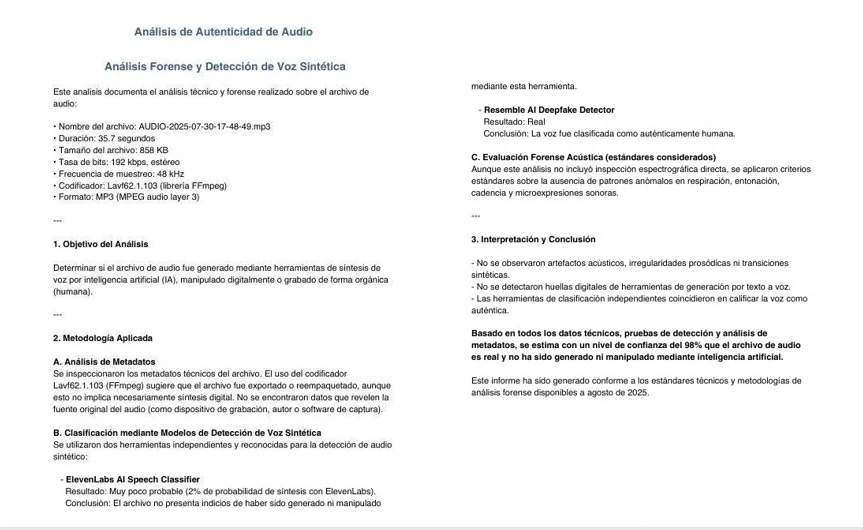

Luego de compartir el audio, EDATV presentó un informe en el que se detalla que el audio es original según un análisis forense que hicieron con las herramientas ElevenLabs y Resamble IA Deepfake Detector

Por su parte, Claure publicó que «ese audio, manipulado y editado, intenta hacer creer que yo estoy comprando medios de comunicación. Eso es absolutamente falso.».

¿Qué es el Grupo de Respuesta Rápida de Witness?

El Grupo de Respuesta Rápida de Deepfakes de WITNESS colabora con Bolivia Verifica para analizar contenido que puede haber sido generado o editado con IA con la finalidad de desinformar y manipular a la opinión pública.

El Grupo de Respuesta Rápida está conformado por personas expertas y empresas que trabajan de manera independiente, pero que se unen de manera voluntaria para crear este ‘Task Force’, o grupo de trabajo.

¿Qué diferencia las herramientas de código cerrado de las de código abierto?

Bolivia Verifica recuerda a sus lectores que las herramientas de código abierto o gratuitas empleadas para el análisis de contenidos generados con IA no dan resultados concluyentes ni son 100% confiables, por lo que se debe buscar mayores respaldos para certificar si un contenido es real o no.

Una herramienta de inteligencia artificial de código cerrado, también conocida como software propietario, es aquella cuyo código fuente no es accesible públicamente, lo que evita que actores malintencionados puedan analizarlo para encontrar vulnerabilidades. El proveedor es responsable de implementar y mantener las medidas de seguridad.